“90%的科研都是垃圾。”

这不是来自学术批评者的攻击,也不是媒体的耸人听闻,而是一位h指数88、总被引次数超过3.5万次的资深学者的自我反思。

2025年1月7日,澳大利亚昆士兰科技大学教授Adrian Barnett在其个人博客上发表了一篇题为“90% of scientific research is crap”的文章。引用“Sturgeon定律”和学术界关于研究浪费的数据,为这一论断提供证据支持。

一年后,2026年1月,Nature杂志职业专栏发表Barnett的另一篇文章“I'm going to halve my publication output”,宣布了一个不同寻常的决定:他将把自己的年出版论文数从过去五年的15篇减少到7篇。

在Nature文章中,Barnett提出了支撑其“减产”决定的三个核心论断:出版系统正在经历不可持续的膨胀、研究质量正在下降、系统面临崩溃风险。

科研原本是为了解决问题,不是为了凑指标

几百年前,科研的逻辑很朴素:有人遇到解释不了的现象,有人想弄明白某个规律,于是反复尝试、记录过程,供后来者参考。那时的论文更像是给同行的一封长信,核心是“我做了什么,发现了什么,可能错在哪里”。

但今天的科研早已不是这套逻辑在主导。科研首先是一份工作,其次才是一种探索。作为工作,它必然被纳入绩效考核体系。考核需要量化,量化需要指标,而最容易数的指标永远是数量。

当论文数量、期刊等级、影响因子成为升职、评职称、拿项目、留教职的硬通货时,科研行为被系统性地“拧歪”。不是研究者不想做好研究,而是在现有规则下,做好研究往往是最不划算的选择。一个需要五年才能出结果的问题,与一个三个月就能发一篇的“小修小补”,在考核表里完全不对等。

久而久之,科研从“解决问题”变成了“完成任务”。

为什么“垃圾科研”大量出现且几乎不可避免

“90%的科研是垃圾”并非否定科研工作者的努力,而是在描述一种结构性结果。科研本质上是高失败率的探索活动,绝大多数假设会被证伪,绝大多数方向会走不通。真正能留下的成果本就是少数。

问题不在于“失败多”,而在于这些失败被迫以“成功”的形式呈现。当系统要求每年必须产出若干篇论文时,研究者不可能写“我们试了三年,发现这个方向行不通”,因为这种论文几乎没有生存空间。于是失败被包装成“阶段性成果”,微小差异被无限放大,重复验证被重新命名,数据被选择性呈现。不是研究者天生不诚实,而是系统只奖励一种行为。

在这样的环境中,大量“看起来合规、实际上空转”的论文被制造出来,它们逻辑自洽、格式规范、引用齐全,但对世界的理解几乎没有推进。

出版膨胀的证据

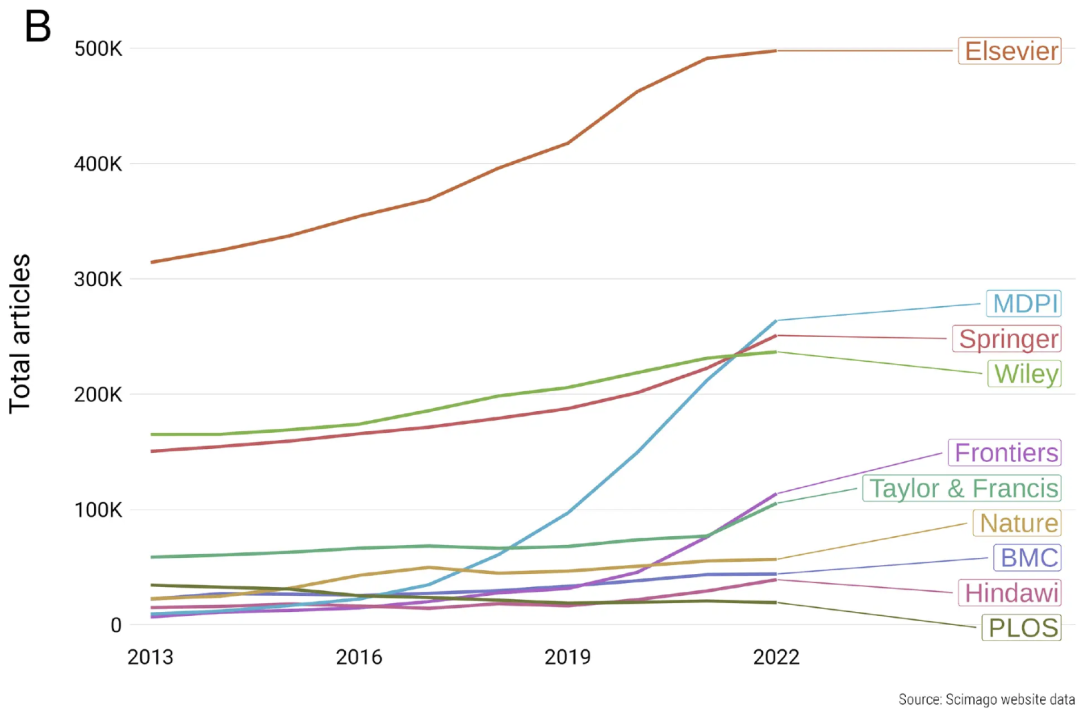

Barnett在Nature文章中提供了出版膨胀的确凿证据:PubMed数据库在2014年索引约120万篇文章,到2024年已超170万篇,十年增长40%以上。这意味着2024年每分钟约有3.2篇新论文发表。

另一个惊人现象是“超级高产者”。斯坦福大学John Ioannidis等人2024年发表在Scientometrics上的研究显示,一些“超级高产者”每年发表超过60篇论文,平均每周至少一篇。考虑到高质量论文需要经历文献回顾、数据收集、分析、撰写、评审等漫长周期,一年完成60篇论文只能通过降低质量标准实现。

Mark A. Hanson等人2024年发表在Quantitative Science Studies上的研究指出,同行评审系统正承受巨大压力,审稿周期延长,质量下降。这形成恶性循环:论文越多,审稿人越不堪重负,低质量论文越容易通过,从而鼓励更多人发表更多论文。

驱动出版膨胀的不只是个人压力,还有制度性因素。2022年Barnett等人在eLife发表的研究发现,职业中断期间产出减少会显著影响资助成功率。这构成一个悖论:口头重视质量,但制度设计实际上在奖励数量。

论文数量增长本身不是问题,问题在于质量正在下降,系统已出现崩溃迹象——同行评审过载、低质量论文激增、学术不端加剧,而增长主要由“不发表就灭亡”压力驱动,非真实的科学进步。Barnett警告:“如果我们不放慢速度,出版系统的更多部分将会崩溃,科学进步将被阻碍。”

科研本来就不是一件高效的事。它需要时间,需要失败,需要耐心,也需要允许大多数尝试“看起来没什么用”。如果有一天,我们能坦然接受这一点,那么“90%的垃圾”就不再是刺耳的指控,而只是探索世界时必然要付出的成本。那时,真正有价值的10%,也许才会更容易被看见。

摘要: 资深学者Adrian Barnett直言“90%科研是垃圾”并决定论文减半,直指学术出版膨胀、质量下降与系统崩溃风险,呼吁反思量化考核对科研本质的扭曲。

19123189289

19123189289

dissertation@delpvip.com

dissertation@delpvip.com

渝公网安备50019002504948号

渝公网安备50019002504948号